眼球追蹤在部分商用場景已經得到應用,這是一項價值潛力極大技術。目前,主流的非近眼的眼球追蹤方案來自于Tobii等,其往往需要專業的硬件設備,價格也相對昂貴,普及尚存一定障礙。

近眼顯示領域的眼球追蹤方案,例如Tobii在AR、VR眼鏡提供的方案,不過它仍需要高度集成的硬件。雖然目前可實現更高度的集成效果,最新Tobii Pro Glasses 3可以做到和普通眼鏡大小、厚度類似,能實現高精度眼球追蹤方案,未來值得期待。

在近眼顯示領域,眼球追蹤技術的優勢很多:增強AR/VR交互,令交互更自然;提供了全新的內容玩法;優化顯示效果,提升顯卡渲染的利用率;提供熱力圖追蹤,進行輔助視覺判斷等等。

而在非近眼的眼球追蹤領域,例如手機、平板、電腦、汽車等更多場景中,眼球追蹤可以發揮不同的作用,例如給PC游戲提供新的交互玩法,在智能手機或PC進行視頻通話時,可以進行眼球視角的糾正;在汽車場景中,實現疲勞駕駛提醒等。

當然,眼睛作為人類交互的重要方式之一,在微動作、微表情等心理研究,醫療健康、在線教育等領域同樣有極大應用潛力。

基于AI、不受硬件限制

除了基于專業硬件的眼球追蹤方案外,基于軟件簡易化或便民的眼球追蹤方案也有一些,它們往往通過低價取勝,應用在一些精準度要求不高的場景中。但是,這些方案往往特別容易受光線所影響,一旦光線復雜或環境光低就會影響追蹤效果。

近期,微軟雷德蒙德研究院在Arxiv發布預印論文《面向廣泛硬件的AI眼球追蹤方案》(Towards Hardware-Agnostic Gaze-Trackers)。

在論文中,就明確提出了一套基于AI的、不受硬件限制的、且不易受光線環境影響眼球追蹤方案。

這套方案特點是:?完全可基于手機、PC的攝像頭,而這些攝像頭均為非高精設備。

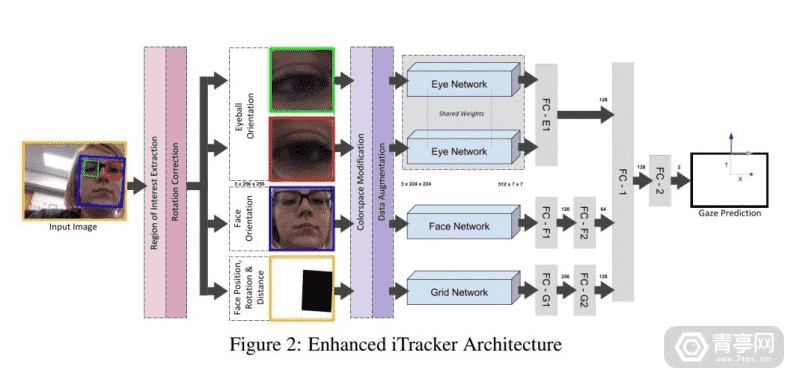

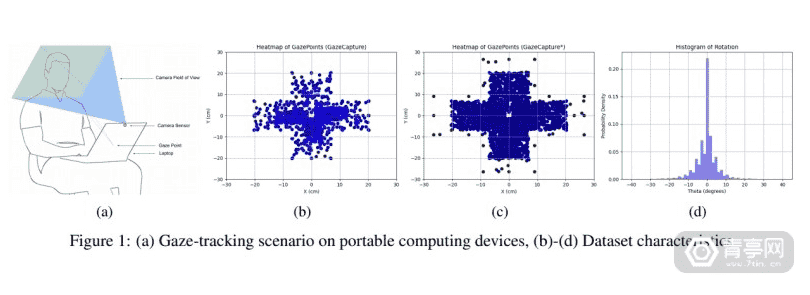

實際上,這項論文的基礎來自于MIT iTracker的GazeCapture研究項目,這是基于AI眼球追蹤模型,其可運行在蘋果設備中,該研究在未經校準情況下,于iPhone和iPad中的誤差分別為1.86cm和2.81cm。

而微軟的目標則是,讓這套系統可以在智能手機和平板電腦之外的設備上使用,例如在PC中實現類似鼠標的操作。

微軟的方案在已公布的MIT語料庫GazeCapture中測試誤差為1.8073cm,并已經集成了1450人的眼球追蹤數據,可以做到無需校準或微調即可使用。

細節方面,微軟研究員將左眼、右眼、面部作為輸入數據,使用25×25像素面部網格,基于ResNet18進行子模型分析訓練。

為了更好的滿足顯示環境中復雜的光線環境,微軟研究員還會隨機更改圖像亮度、對比度、飽和度、色調等,并隨機裁剪大小,增加噪點,從而防止模型過度擬合。

然后再將此模型和人臉檢測庫Dlib結合,從而可以實現GazeCapture不支持的眉毛和唇部動作數據,進一步實現面部輪廓數據的整合,包括面部微動作、眼睛動作。最終,通過這些數據消除誤差。

其中發現了一個特性,當人眼看向特定區域時,面部肌肉就會呈現特定動作,這里綜合眉毛和唇部動作就可以實現更精準的追蹤,從而提升精準度。

當然,目前這一研究也存在一些問題,例如面部一旦遇到遮擋,就會影響精準度等。但未來隨著數據量的提升,目標無疑是在手機、平板、PC等廣泛的電子消費產品中得到廣泛應用。

類似應用或玩法

實際上,微軟在眼球追蹤和身份驗證方面一直有研究,例如在Windows 10中提供的Windows Hello中的面部、虹膜等解鎖方案,并且Windows 10也是第一個系統級別眼動控制的操作系統版本。

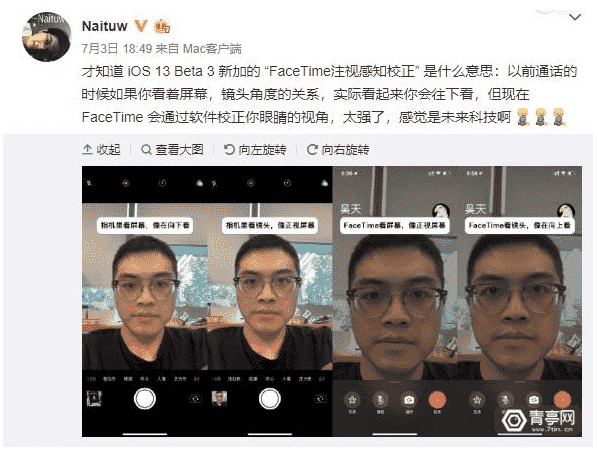

例如,蘋果ARKit 3中就提供了FaceTime注視感知校正功能。手機的前置鏡頭當你看著屏幕時,眼睛注視區實際是向下的,因為攝像頭在屏幕上方。當然如果你看攝像頭拍照你的眼睛注視才是正常的盯著屏幕看。而在視頻通話中,如果你看著屏幕,而對方認為你注意力不在,那會是一件不禮貌的事情。

為此,蘋果在FaceTime視頻通話中就改善了這一問題:即使你盯著屏幕看也沒事,ARKit 3會自動將你的眼睛注視方向調整為正常視角,雖然你看的是屏幕,但是對方看到的你跟“看向攝像頭”視角是相同的。

目前該功能僅在A12和A12X,且具備前置TrueDepth原深感相機的設備中運行。

來源:青亭網